Arborescentes (2023–2025)

Instalación biointeractiva con plantas reales, sensores GSR y conversión de conductancia en datos musicales.

Esta es la colección completa de mis trabajos recientes en la intersección de música, código y arte interactivo.

Instalación biointeractiva con plantas reales, sensores GSR y conversión de conductancia en datos musicales.

Instalación donde un parlante en movimiento tridimensional dispara capas sonoras mediante tracking.

Instrumento virtual basado en MediaPipe + Python, controlado por gestos y enviado por OSC a 'Reaper'.

Tablero físico conectado a un celular. La app en Unity + Wwise modifica la música dinámicamente.

Trabajo en el cruce entre sonido y tecnología. Mi obsesión no es solo producir audio, sino crear sistemas donde el sonido cobra vida propia.

Soy artista sonoro y desarrollador de sistemas interactivos. Exploro cómo un sistema (sea un cuerpo humano, una planta reaccionando a la luz o un algoritmo generativo) puede transformar y redefinir un espacio acústico sin la necesidad de una intervención humana constante y controlada.

He desarrollado obras que fusionan sensores biométricos, visión por computadora, machine learning y síntesis generativa. Construyo instrumentos y experiencias inmersivas donde la frontera entre el autor humano y el procesador tecnológico se desdibuja.

Actualmente formo parte del CEES (Centro de Estudios y Experimentación Sonora), un espacio dedicado a promover el arte sonoro y la tecnología creativa. Simultáneamente, colaboro con El Zorro Azul, desarrollando herramientas procedimentales para audio en videojuegos.

Mi formación es híbrida: combina la rigurosidad de la música académica, la lógica de la ciencia de datos y la creatividad del diseño interactivo. Trabajo entre la composición y el código, buscando siempre que lo orgánico y lo digital conversen en el mismo idioma.

Si tienes un proyecto de tecnología, música o arte interactivo, no dudes en contactarme. Estoy disponible para nuevas colaboraciones.

Junto a Julián Micic de Rosas, creamos 'Arborescentes', instalación que explora la comunicación no verbal y la respuesta de las plantas a través de la sonificación. Utiliza un sensor de respuesta galvánica de la piel (GSR) conectado a una planta para medir sus microvariaciones eléctricas. Estos datos se interpretan como parámetros de composición, generando paisajes sonoros adaptativos en tiempo real que reflejan el estado biológico del organismo.

El diseño de hardware incluye un circuito de bajo ruido para la lectura del sensor GSR, alimentando una señal estable que se procesa en código (Python) para mapeo de datos y, finalmente, se envía a 'Reaper' para la síntesis de audio espacializada.

Se incorpora además un sistema de visión por computadora (OpenCV) que detecta la presencia y el movimiento de las personas en el espacio expositivo. La presencia humana funciona como puerta o modulador del sistema: cuando la sala está vacía, la planta sostiene un paisaje sonoro más sobrio y contenido; cuando alguien entra o se desplaza, se activan cambios de modo, efectos e intensidad, habilitando nuevas respuestas del ecosistema sonoro y configurando la instalación como un diálogo entre planta, algoritmo y cuerpo humano.

En configuraciones multicanal, dos grupos de plantas controlan fuentes sonoras diferenciadas que se responden entre sí, componiendo una conversación distribuida en la que cada “voz” vegetal se ve afectada por las variaciones de las otras en tiempo real.

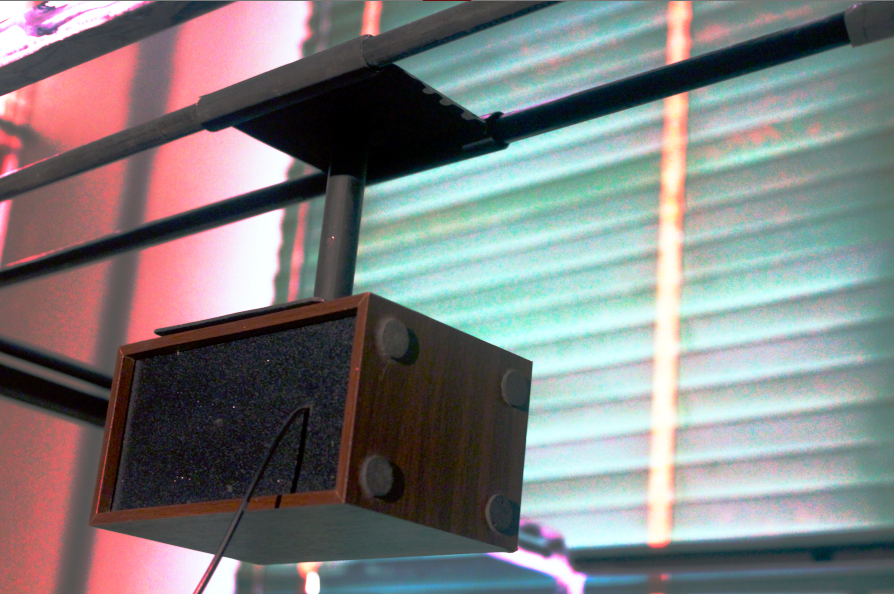

Esta pieza es una exploración sobre la relación física entre la fuente sonora y el espacio. A través de un sistema de rastreo (tracking) en tiempo real, se monitorea la posición de un parlante móvil suspendido.

Los datos de movimiento (coordenadas espaciales) se utilizan para disparar y modificar capas sonoras dinámicamente. El resultado es una experiencia donde el sonido no es estático, sino que viaja y muta según su ubicación física en el entorno tridimensional, creando un diálogo constante entre la mecánica del dispositivo y la acústica de la sala.

'Keythereum' es un controlador musical virtual que utiliza la visión por computadora para la manipulación sonora. El instrumento no requiere contacto físico y se basa en el reconocimiento de gestos de las manos del intérprete a través de una cámara web. El sistema utiliza la biblioteca 'MediaPipe' de Google para detectar y rastrear los puntos clave (landmarks) de la mano en tiempo real.

El flujo de datos se gestiona con 'Python', convirtiendo coordenadas en mensajes 'OSC'. Estos mensajes son enviados a 'Reaper' para controlar parámetros de síntesis, efectos y mezcla.